碎碎念

把服务器升级到了 2c4g 了,部署了很多东西,以后会出一篇文章介绍我部署的项目(画大饼ing

由于在学校有要使用 AI 的需求,但是大厂的 AI 都需要手机号登录,所以就有了自部署的需求,最终找到了 NextChat,Chatnio,Librechat,Lobechat 这类项目,其实主要就是个前端,然后调用 api 进行对话 最终选了 Librechat,看中了它的 UI

Librechat 简介

www.librechat.ai

https://www.librechat.ai/

LibreChat 是一款功能强大的开源自托管 AI 聊天机器人框架,它在一个统一的界面中集成了多种主流 AI 模型,包括 OpenAI GPT、Google Gemini 和 Anthropic Claude 等,让用户能够根据需求在不同模型间无缝切换。该平台支持多模态交互,允许上传和分析图像,并具备语音输入输出功能,同时通过插件系统扩展了图像生成和实时网络搜索等能力。作为可自行部署的解决方案,LibreChat 在提供丰富功能的同时,也确保了用户数据的隐私和安全,是追求灵活性和控制权的用户的理想选择。

Docker Compose 部署

Docker 还是比较方便的

首先确保你的服务器有 docker-compose 和 git

- 克隆仓库

$git clone https://github.com/danny-avila/LibreChat.git- 配置文件

$cp .env.example .env这里面没啥好配置的,具体看文档

www.librechat.ai

https://www.librechat.ai/docs/configuration/dotenv

小提示 如果你要配置国内的 AI,那么建议不要在 .env 中设置,后续配置 librechat.yaml 会更方便

- 启动

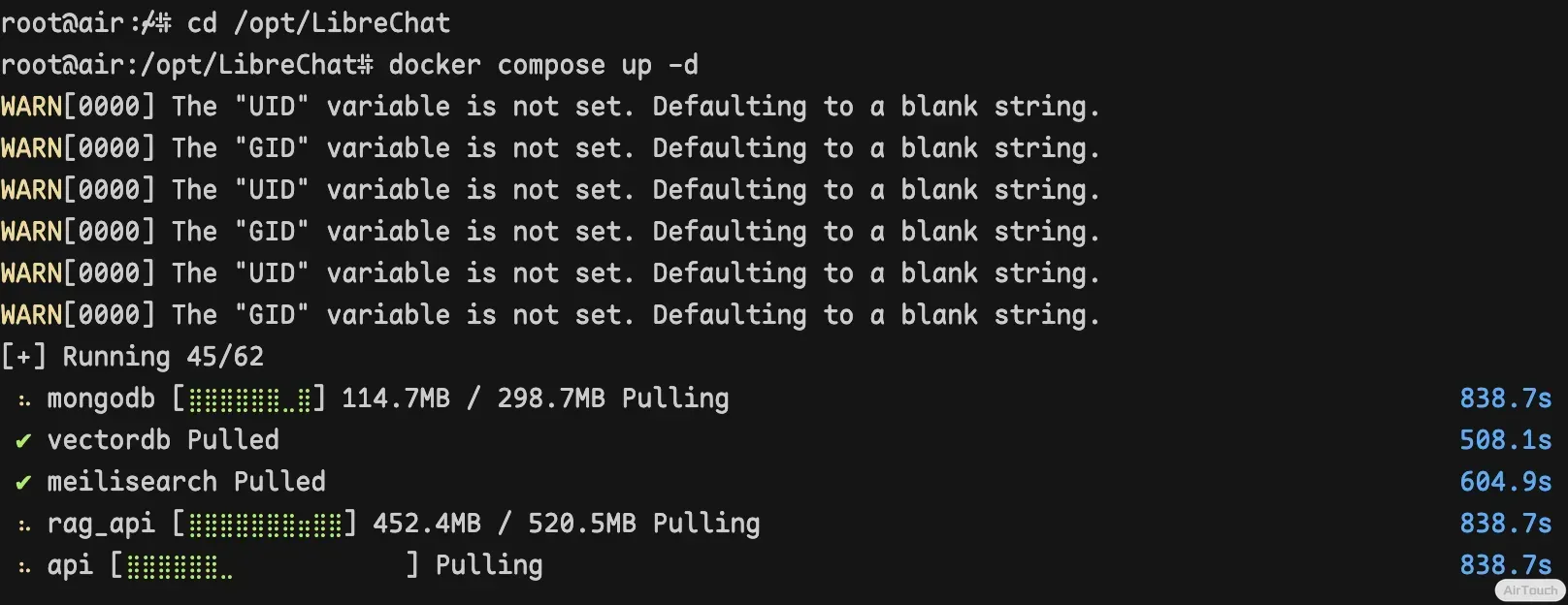

$docker compose up -d然后会自动安装依赖并启动,用时比较久,大概需要 20 分钟

启动成功之后访问 3080 端口即可

使用自定义渠道

- 添加

docker-compose.override.yml内容如下

services:

api:

volumes:

- type: bind

source: ./librechat.yaml

target: /app/librechat.yaml

- 添加

librechat.yaml

$cp librechat.yaml.example librechat.yaml找到

endpoints: custom:

下面添加自定义 AI,格式如下

- name: "" apiKey: "" # api key baseURL: "" # api 地址 models: default: ["", ""] fetch: false # 是否自动获取可用模型 iconURL: "" # 模型图标 titleConvo: true titleModel: "" summarize: false summaryModel: "" forcePrompt: false modelDisplayLabel: "" # 显示名称

注意,如果要使用 librechat.yaml 配置,那么 .env 里的 ENDPOINTS: 要注释掉,否则会冲突

- 重启

$docker compose up -d然后就好了捏

评论加载中...